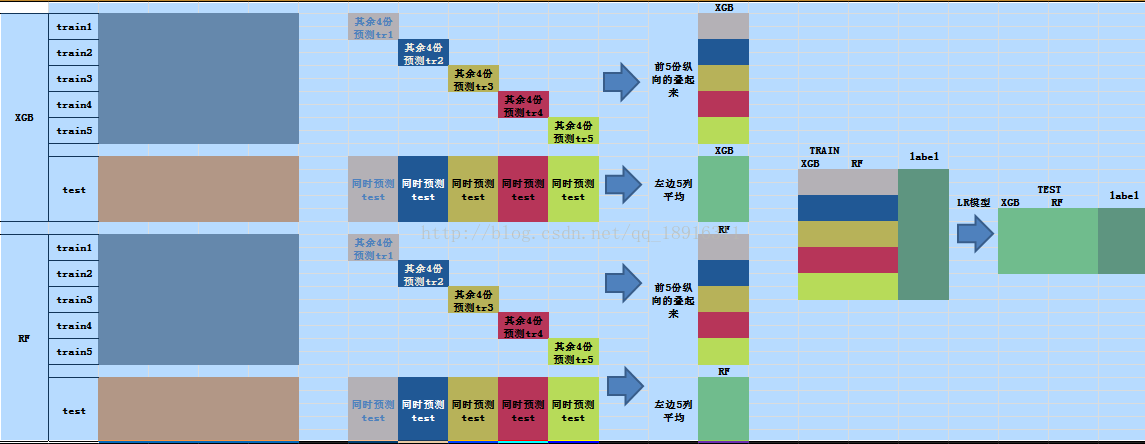

先由所有基模型对训练集进行预测,使用交叉验证或者留一法生成新的训练集,再由次级学习器(多使用线性回归)训练。

一个例子:

XGB模型,把train分train1~train5,共5份,用其中4份预测剩下的那份,同时预测test数据,这样的过程做5次,生成5份train(原train样本数/5)数据和5份test数据。然后把5份预测的train数据纵向叠起来,把test预测的结果取平均。

RF模型和XGB模型一样,再来一次。这样就生成了2份train数据和2份test数据(XGB重新表达的数据和RF重新表达的数据),将它们并列合并。然后用LR模型,进一步做融合,得到最终的预测结果。